TOPIC 1 · AI 발전사

AI는 어떻게

여기까지 왔을까?

이 흐름을 알면 도구를 제대로 쓸 수 있다

매번 "이건 왜 안 되지?"라는 문제를 풀며 진화해왔다

ERA 0 · 프롤로그

AI가 사람 말을 알아듣게 된 순간

BEFORE

GPT-3 (2020)

크기: 1,750억 파라미터

능력: 글을 잘 쓰지만

문제: 사람 의도를 무시

"요약해줘" → 엉뚱한 장문

AFTER

InstructGPT (2022)

크기: 13억 파라미터 (100배 작음)

비밀: RLHF(사람 피드백 학습)

결과: 사람들이 더 선호

"요약해줘" → 깔끔한 요약

핵심 교훈:

크기보다

"사람 말을 듣는 훈련"이 중요했다.

이것이 ChatGPT 혁명의 숨은 열쇠.

Ouyang et al. (2022) — InstructGPT 논문

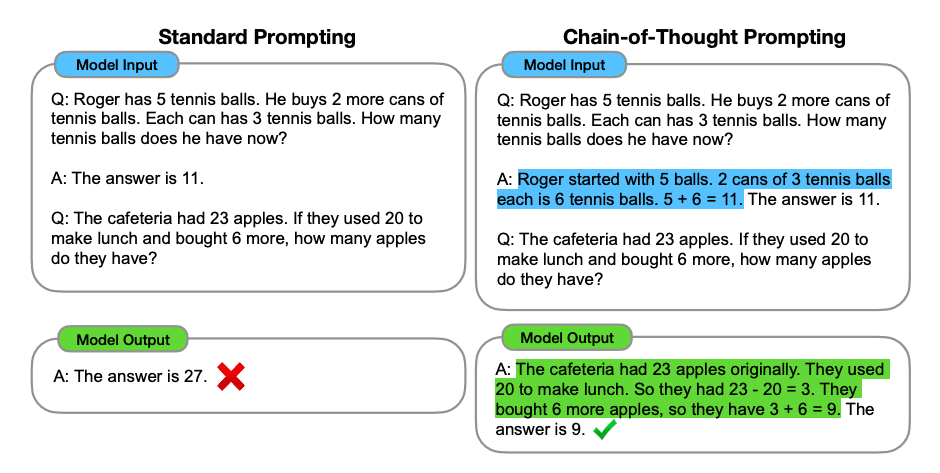

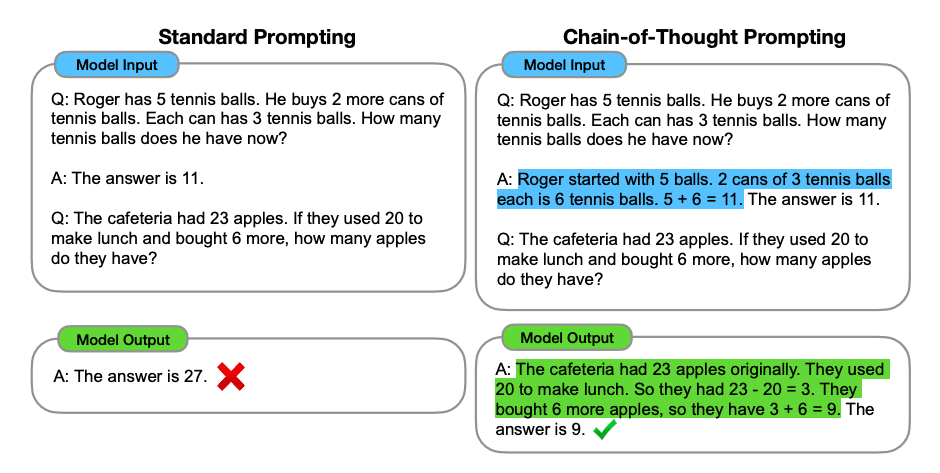

ERA 1 · 프롬프트 엔지니어링

"단계별로 생각해봐" 한 줄의 마법

正 · 화두

"말을 잘 걸면

더 좋은 답이 나올까?"

2022년, 프롬프트 엔지니어가

가장 핫한 직업으로 등장

反 · 한계

기법이 58가지 이상 난립

모델마다 효과가 달라서

비전문가는 좌절 (Johnny Can't Prompt)

合 · 돌파

Chain of Thought(CoT)

수학 정답률

17.7% → 78.7%

출처: DAIR.AI Prompting Guide (MIT License)

비유: "스쿼트 해주세요" vs "발을 어깨 너비로 벌리고, 무릎이 발끝을 넘지 않게..."

과정을 구체적으로 써주면 AI도 더 정확해진다.

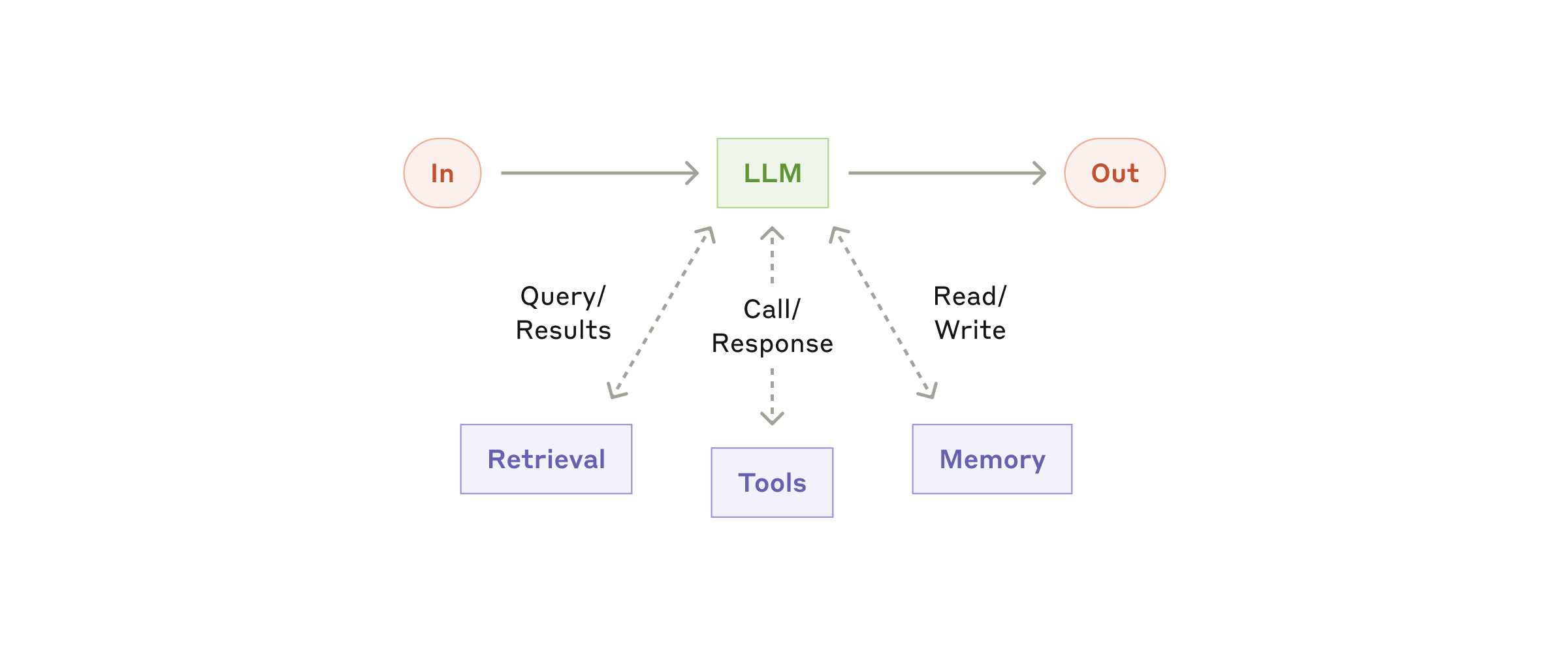

ERA 2 · 지식 확장

오픈북 시험 + 기억 용량 100배

正 · 화두

"AI가 내 자료는

모르잖아요"

AI의 학습 데이터는

과거 어느 시점에서 멈춰 있음

反 · 한계

환각(Hallucination)

AI가 자신 있게 틀린 정보를

만들어내는 심각한 문제

合 · 돌파

RAG + 기억 창 확장

답하기 전에 내 자료를 먼저 검색

기억: 소설 한 권 → 백과사전

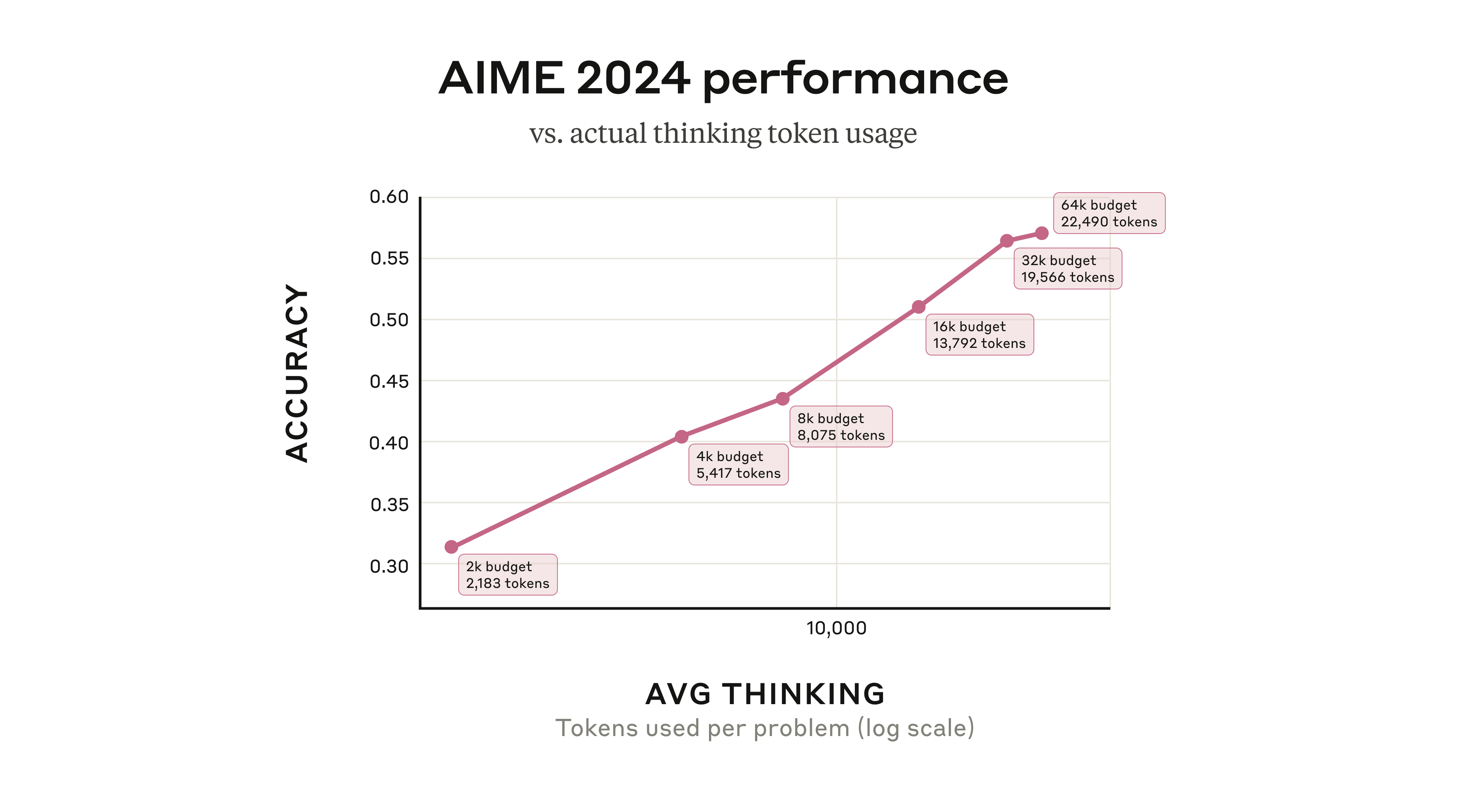

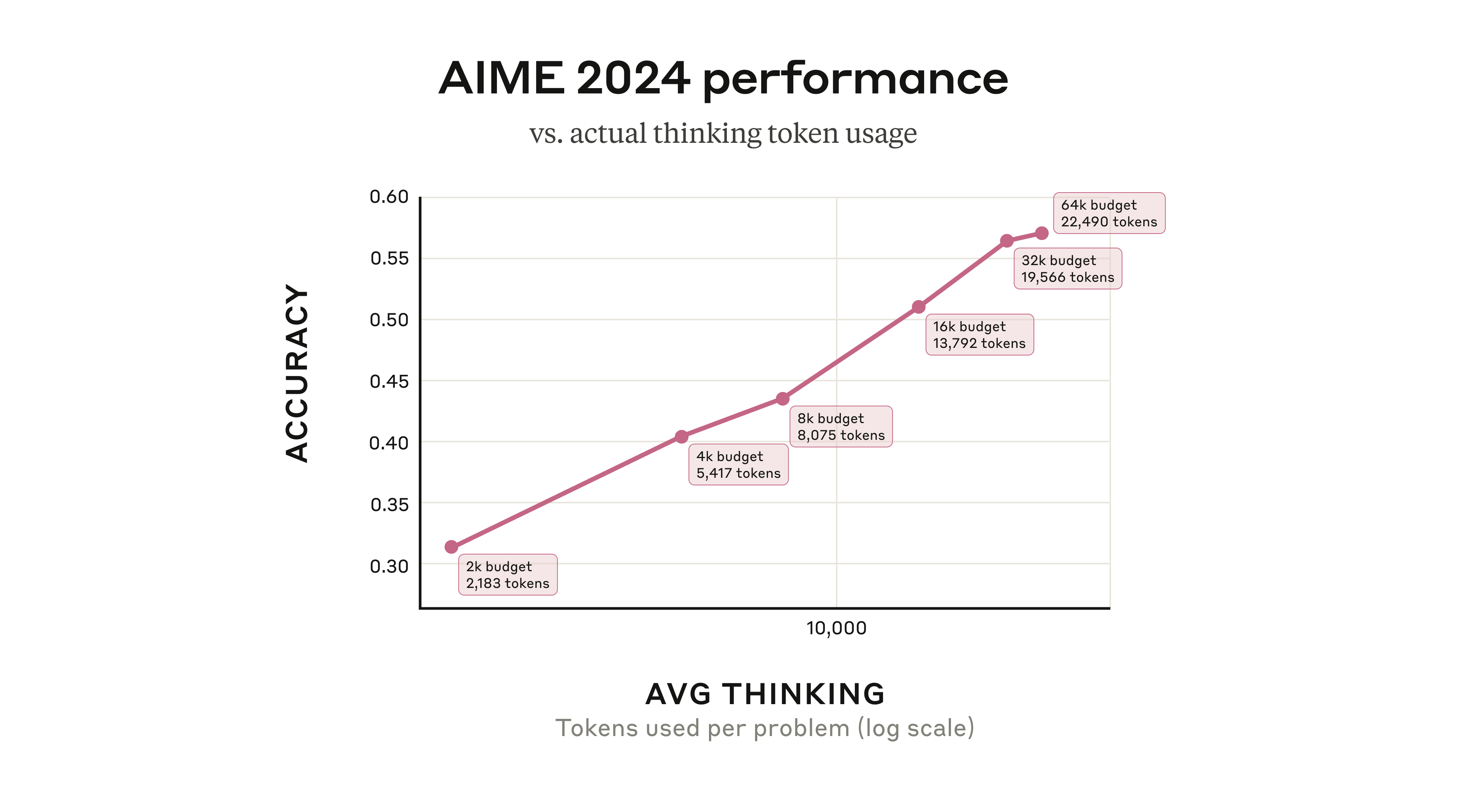

ERA 3 · THINKING

느린 숙고의 힘

正 · 화두

"정말 어려운 문제는

AI도 못 풀잖아요"

빠른 직관은 있지만

깊은 사고는 부재

反 · 한계

수학 올림피아드 정답률

GPT-4o: 12%

10명 중 1명만 맞히는 수준

合 · 돌파

Extended Thinking

o1: 74% (10명 중 8명)

생각 과정을 공개하는 투명성

출처: Anthropic — Extended Thinking 정확도 vs Thinking Tokens (AIME 2024)

비유:

신입 트레이너(1초 답변) vs

베테랑 트레이너(고객 상태를 꼼꼼히 살피고 답변)

AI도

생각하는 시간이 필요하다.

OpenAI o1 (2024.09) · Claude Extended Thinking (2025.02)

WOW 모먼트

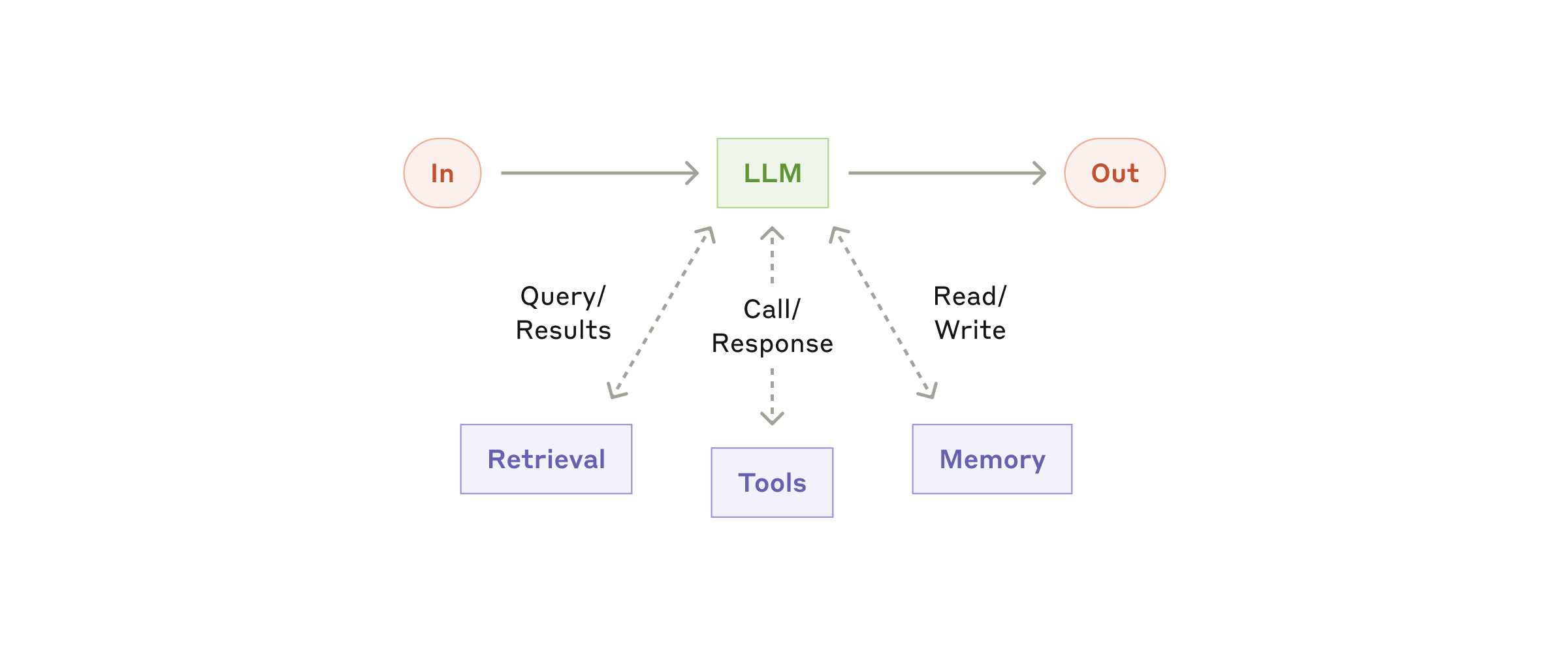

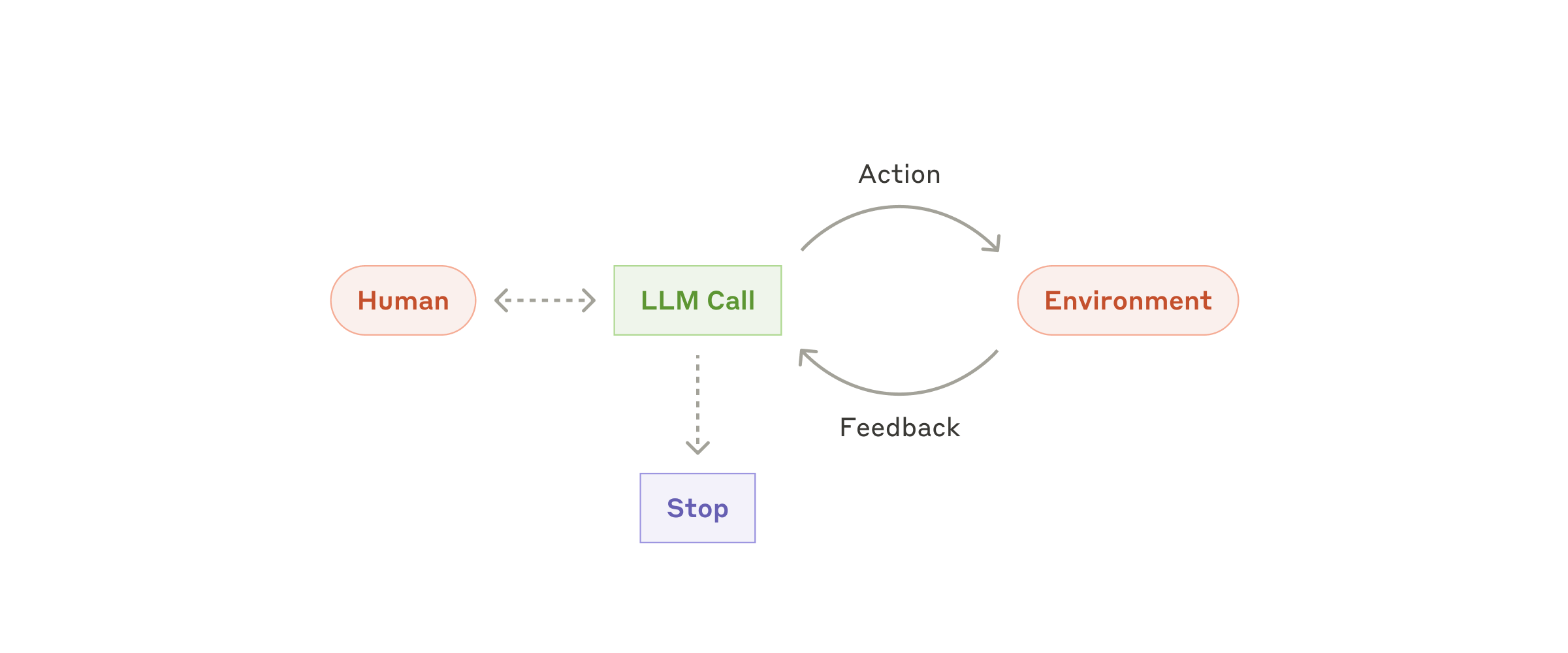

ERA 4 · 도구 사용

AI가 직접 컴퓨터를 조작한다

正 · 화두

"AI가 말만 하고

실행은 못 하잖아요"

대화만 가능한 챗봇의 한계

反 · 한계

AutoGPT의 꿈과 좌절

GitHub 별 5만+개, 하지만

통제 불가 + 비용 폭발

合 · 돌파

Function Calling

+ Computer Use

통제된 도구 사용

화면을 보고 클릭까지

"AI가 화면을 보고, 커서를 움직이고, 버튼을 클릭합니다"

Anthropic Computer Use (2024.10) — 사람처럼 컴퓨터를 조작하는 AI

출처: Anthropic 공식 블로그

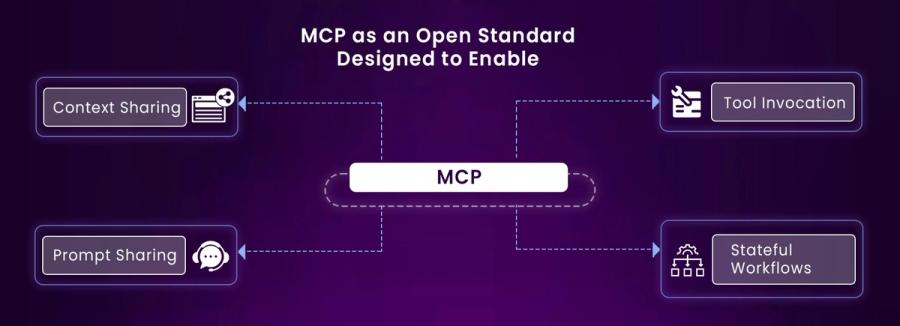

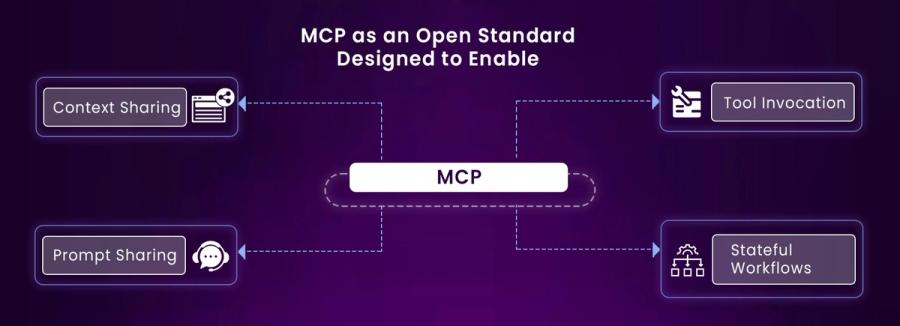

ERA 4b · MCP

USB 포트처럼 꽂으면 연결

BEFORE

🔌

도구마다 다른 규격

A 도구는 A방식, B 도구는 B방식

연결할 때마다 개발자 필요

AFTER — MCP

🔗

표준 규격 하나로 통일

어떤 도구든 꽂으면 바로 연결

OpenAI, Google도 채택한 업계 표준

출처: Kubiya — MCP Open Standard Architecture

MCP (Model Context Protocol, 모델 컨텍스트 프로토콜)

= AI와 외부 도구를 연결하는

USB 표준

Anthropic (2024.11) — 업계 표준으로 채택

ERA 5 · AI 팀

AI 한 명이 아니라 팀으로 일하기

正 · 화두

"복잡한 일은

AI 혼자 못 하잖아요"

PT 센터에서도 원장 혼자

모든 일을 하진 않죠

反 · 한계

초기 멀티에이전트의 혼란

비용 15배 + 신뢰성 부족

AI 50명이 제각각 일하는 참사

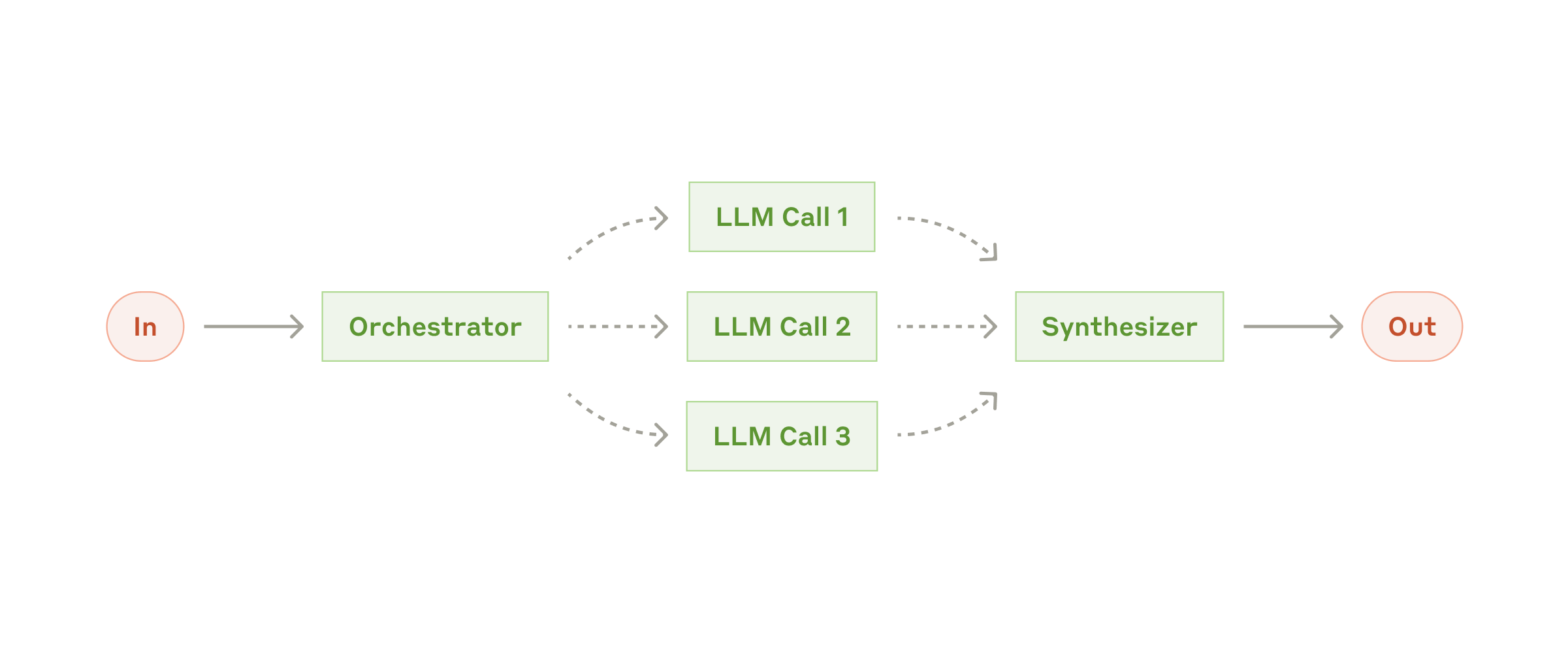

合 · 돌파

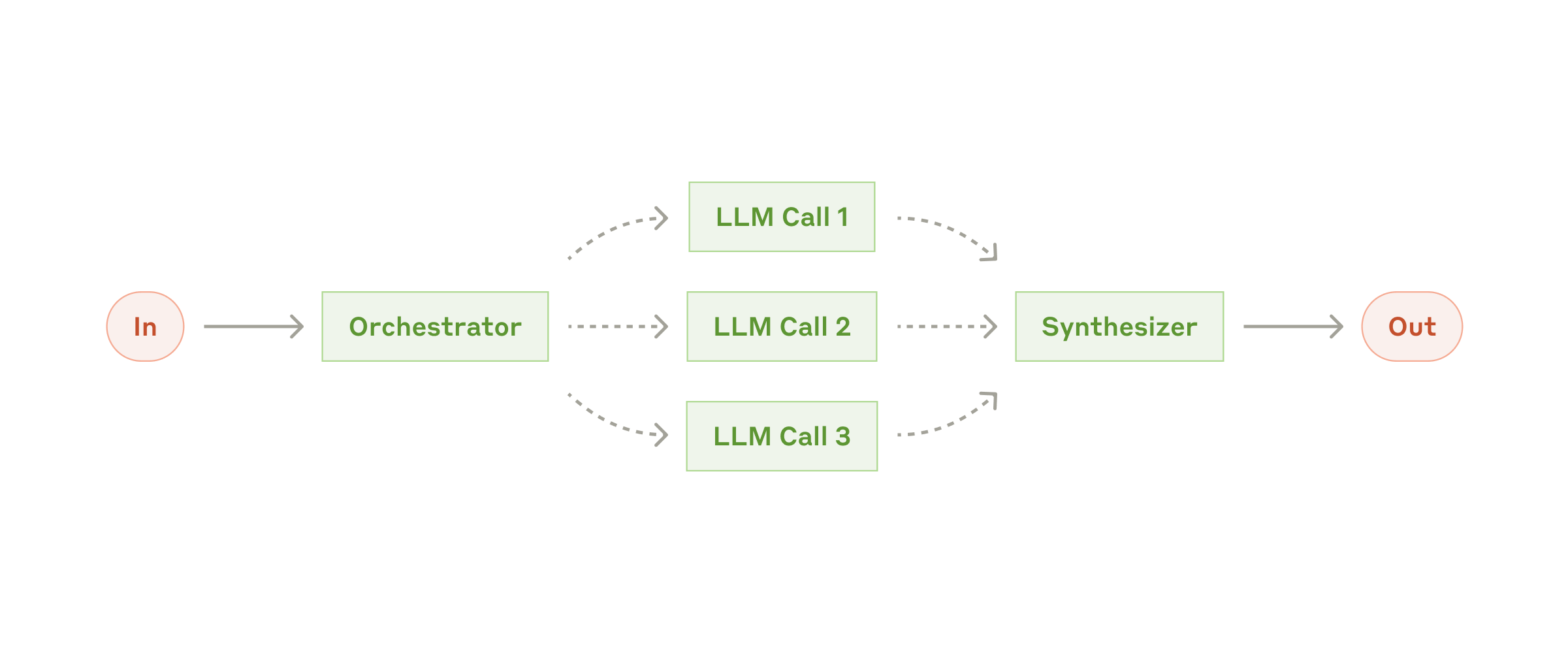

오케스트레이터-워커 패턴

원장이 팀을 지휘하듯

성능 90%+ 향상

출처: Anthropic — Building Effective Agents (2024)

ERA 6 · 하네스

마구(馬具) = AI를 안전하게 모는 장비

🐎

AI = 강력한 말(馬)

빠르고 힘 세지만

그냥 두면 제멋대로

🏇

하네스 = 고삐 + 안장 + 등자

방향을 잡고, 속도를 조절하고

안전하게 목적지로

같은 AI 모델이라도 하네스에 따라

작업 완료율이 40점 차이

Claude Code($1B 매출) = 잘 만든 하네스의 증거 ·

Claude Cowork = 비개발자를 위한 하네스

출처: Anthropic Engineering Blog — Effective Harnesses

"2025년은 에이전트의 해, 2026년은 하네스의 해"

모델은 범용품(commodity)이 되고,

도구(하네스)가 성패를 결정한다.

Anthropic Engineering Blog · Aakash Gupta (2026)

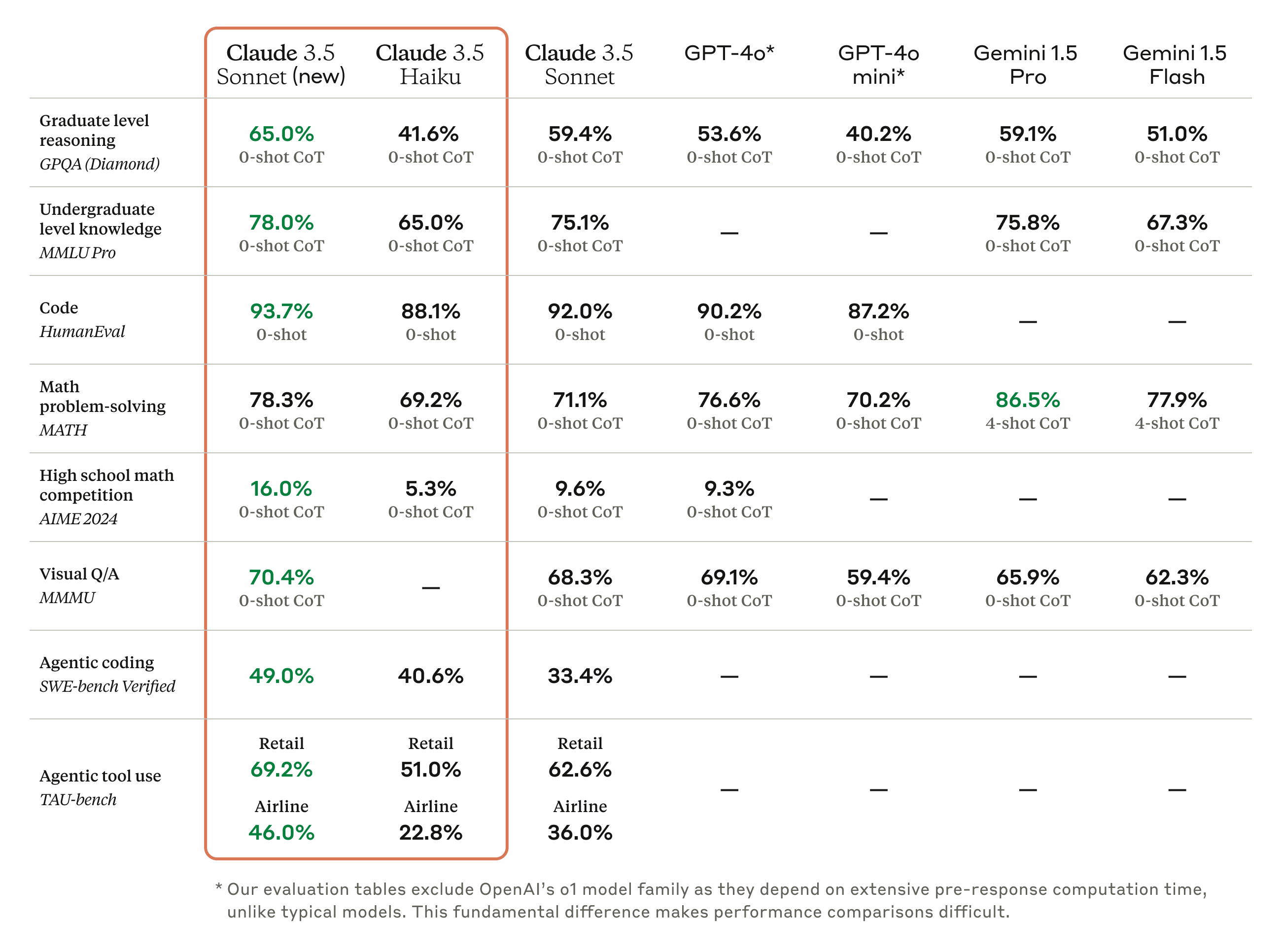

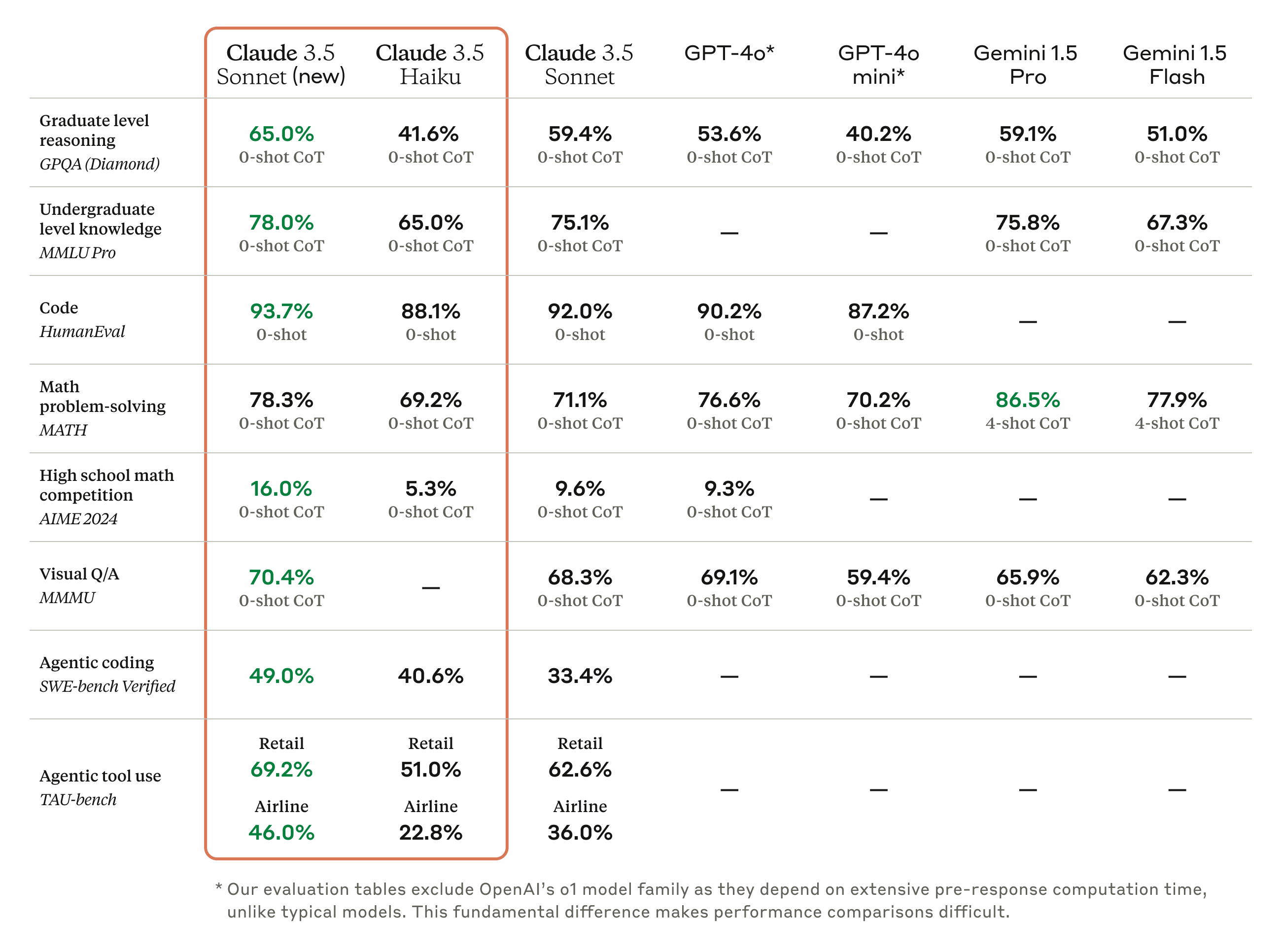

CLAUDE 타임라인

Claude 1 → 4.6 — 함께 성장한 여정

| 2023.03 |

Claude 1 — 첫 출시, 안전성 강조 |

| 2023.05 |

Claude 100K — 소설 한 권 분량 기억 |

| 2024.03 |

Claude 3 Opus/Sonnet/Haiku — 3단계 라인업 |

| 2024.10 |

Computer Use — AI가 화면 조작 (퍼블릭 베타) |

| 2025.02 |

Claude 3.7 + Extended Thinking + Claude Code |

| 2025.11 |

Claude Code $1B 매출 달성 |

| 2026.01 |

Claude 4.6 + Cowork — 비개발자를 위한 에이전트 |

Cowork = "Claude Code가 개발을 바꿨다면,

Cowork는 나머지 모든 업무를 바꾼다"

TOPIC 2 · 살아있는 SW

Software 1.0 → 2.0 → 3.0

"여러분은 이미 프로그래머입니다"

— Andrej Karpathy

SW 1.0

사람이 코드 작성

Python, C++ ...

엑셀 함수, 자동 문자

만드는 사람: 개발자만

비유: 요리 레시피 따라하기

SW 2.0

데이터로 학습

신경망 가중치

이미지 인식, 추천

만드는 사람: +데이터 과학자

비유: AI가 맛을 학습

SW 3.0

말로 지시

한국어/영어 프롬프트

ChatGPT, Claude

만드는 사람: 누구나!

비유: "이런 요리 만들어줘" 주문

"가장 핫한 프로그래밍 언어 = 한국어"

모든 사람이 자연어를 말하니까, 모든 사람이 프로그래머가 됐다.

SW 3.0 · 눈으로 확인

왼쪽을 읽을 수 있으면 개발자

오른쪽을 쓸 수 있으면 여러분

전통 코드 (SW 1.0)

if customer.age > 40:

plan = "low_impact"

sets = 3

if customer.injury == "back":

exclude("deadlift")

add("core_stability")

자연어 지시 (SW 3.0)

"40대 이상 고객을 위한

저충격 운동 계획을 짜줘.

세트 수는 3회로 하고,

허리가 안 좋으니 주의해줘.

데드리프트는 빼고

코어 안정화 운동을 넣어줘."

같은 결과. 다른 언어. 여러분의 언어로 이미 가능합니다.

AI의 본질

AI = 엄청나게 박식하지만

기억 없는 인턴

🧠

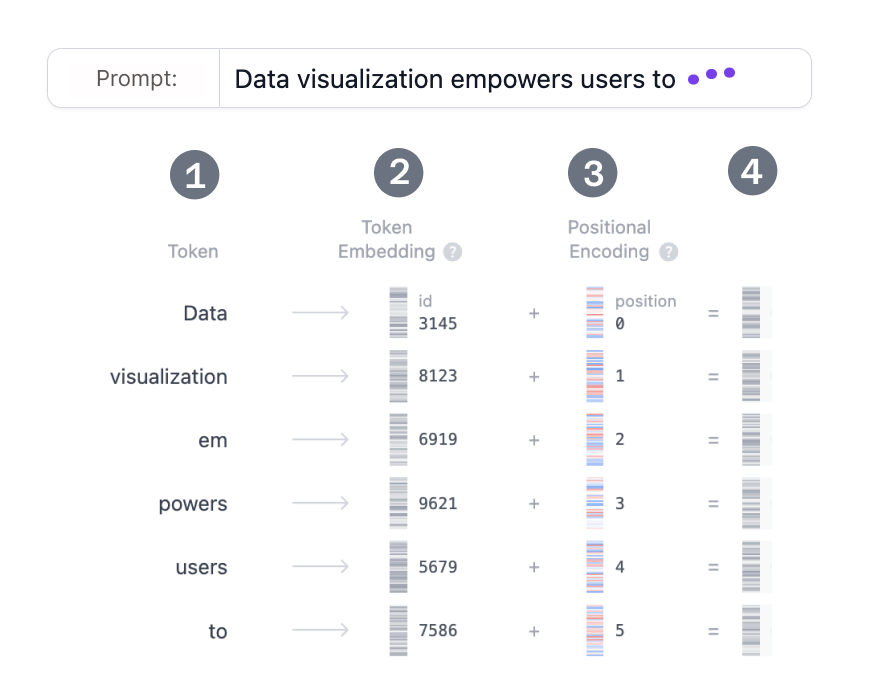

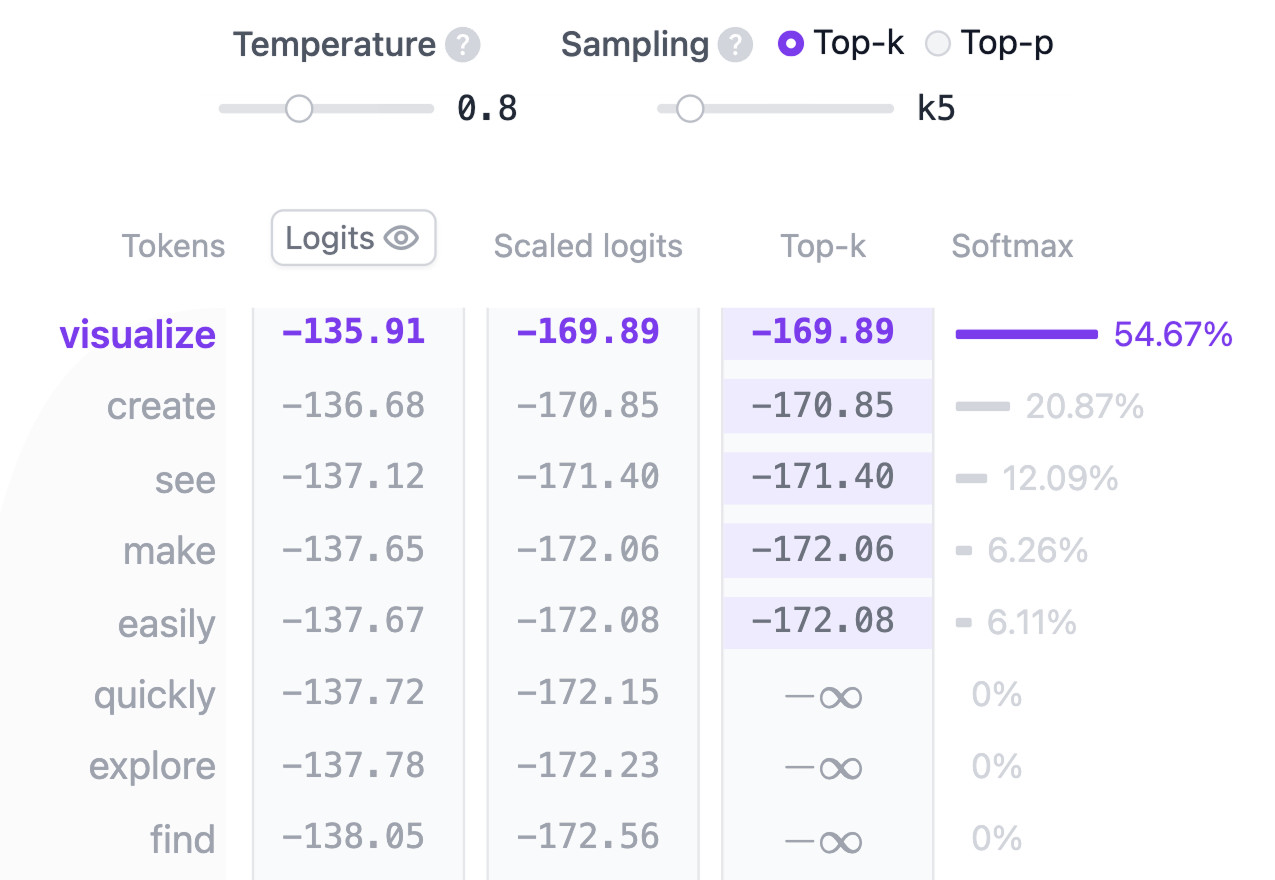

AI가 하는 일 (단 하나)

지금까지 나온 단어들을 보고

다음에 올 확률이 높은 단어를 고른다

이것을 아주 빠르게, 아주 많이 반복

💡

우리에게 의미하는 것

내가 무슨 말을 했느냐에

따라 다른 답이 나온다

맥락을 주면 → 맞춤 답변

맥락 없이 → 일반적 답변

출처: Georgia Tech — Transformer Explainer (오픈소스)

매일 아침 처음 만나는 인턴에게 "어제 얘기했잖아"는 통하지 않습니다.

하지만 "우리 센터는 이런 곳이고, 오늘 이 고객은 이래"라고 설명하면

그 인턴은 놀라운 능력을 발휘합니다. 내가 잘 알려줄수록 AI는 더 잘 일합니다.

메타 프롬프팅

바로 시키기 vs 먼저 설계하기

BEFORE — 일반 프롬프팅

"신규 회원 3개월

운동 계획 짜줘."

↓ 결과

일반적 템플릿 수준

내 고객과 안 맞음

한 방향 →

AFTER — 메타 프롬프팅

"운동 계획을 짜려고 해.

먼저 어떤 정보가 필요한지

목록을 만들어줘."

↓ 결과

체크리스트 + 맞춤 계획

내 고객에 딱 맞는 결과

설계 ↔ 실행 ↔ 점검

메타 프롬프팅 = AI에게 바로 답을 요구하지 않고,

"어떻게 접근할지"를 먼저 함께 설계하는 것

6가지 패턴

메타 프롬프팅, 이렇게 씁니다

1

계획부터 세워줘

"바로 결과물 내지 말고,

결정할 항목부터 정리해줘"

2

결과를 평가해줘

"이 기준으로

점수와 개선 방향 알려줘"

3

의사결정 도와줘

"놓치는 관점 있을까?

반대 입장도 생각해줘"

4

세션 정리해줘

"결정된 것 / 보류된 것 /

다음 할 일 / 핵심 인사이트"

5

나한테 질문해줘

"좋은 결과를 만들려면

뭘 물어봐야 할까?"

6

전체 체인

질문 수집 → 계획 → 실행

→ 평가 → 결정 → 정리

패턴 6(전체 체인)이 바로 "딸깍 한 번이 아니라 함께 걸어나가는" AI 활용

컨텍스트의 힘

같은 AI인데 왜 다를까?

컨텍스트(맥락) = AI에게 불 밝혀주기

🌑

컨텍스트 없음

"운동 계획 짜줘"

AI: 깜깜한 방에서

아무나에게 맞는 답을 추측

→

🌗

일부 컨텍스트

"40대 여성, 허리 통증"

AI: 희미한 불빛으로

대략적 방향은 잡음

→

☀️

풍부한 컨텍스트

"40대 여성, L4-5 디스크,

3개월째 재활 중, 목표: 일상 복귀"

AI: 환한 대낮에

정밀 맞춤 답변

출처: Anthropic — Building Effective Agents

컨텍스트 = 기억 없는 인턴에게 주는 업무 브리핑

내가 잘 알려줄수록 AI는 더 잘 일합니다.

코딩이 아니라 맥락 전달 연습이 핵심입니다.

TOPIC 3 · 인간-AI 협업

AI 혼자보다 인간+AI가 더 강하다

센타우루스 모델 — 결합된 판단의 힘

🧠

인간 단독

직관 · 맥락 이해

윤리 판단 · 창의성

공감과 관계

85%

🏇

인간 + AI

시너지 영역

결합된 판단

각자의 강점을 합치기

99.5%

의료 진단 정확도 사례

🤖

AI 단독

패턴 인식 · 계산

속도 · 일관성

24시간 무한 처리

92%

"아마추어 2명 + 약한 컴퓨터 3대가 슈퍼컴퓨터 단독을 이겼다."

— 체스 토너먼트 결과 (카스파로프 프리스타일 체스)

얼마나 맡길 것인가?

위임 7단계

Appelo의 Management 3.0 — 위임은 이분법이 아니라 스펙트럼이다

인간 통제 ←

→ AI 자율

지시

Tell

"내가 결정"

설득

Sell

"이유 설명"

자문

Consult

"옵션 요청"

합의

Agree

"함께 결정"

조언

Advise

"의견 제시"

확인

Inquire

"결과만 확인"

위임

Delegate

"알아서 해"

양식에 데이터

입력만

AI 추천을

내가 선택

옵션 3개

제시 요청

AI와 대화하며

방향 도출

AI가 판단,

보고만 받기

결과 확인만

가끔

완전 자동

리마인더

출처: Management 3.0 — Delegation Poker

비개발자 시작 추천: 레벨 3~4 (자문~합의)

"AI에게 뭘 시켜야 할지 모르겠다" = 위임 레벨을 모른다는 뜻

통합 스펙트럼 — 큰 그림 보기

위임 레벨, AI 자율성, 나의 감독 수준은 하나의 연속선 위에 있다

위임 7단계

Lv 1-3

지시~자문

Lv 4-5

합의~조언

Lv 6-7

확인~위임

AI 자율성

Lv 1-2

조작자~협력자

Lv 3

자문역

Lv 4-5

승인자~관찰자

나의 감독

문지기

Human-in-the-Loop

"내가 모든 결정에 참여"

감독관

Human-on-the-Loop

"이상하면 내가 개입"

전략가

Human-out-of-the-Loop

"나는 방향만 설정"

여러분의 현재 위치는? 다음 목표는?

비개발자 권장 시작: 위임 2~4 / 자율 1~2 / 문지기 단계 → 신뢰가 쌓이면 점진적 확대

AI 사용법 = 일하는 방식

짧게 나누고, 빠르게 확인하고, 함께 고친다

애자일 스프린트

1. 스프린트 계획

"이번 주 목표 정하기"

2. 데일리 스탠드업

"어제 한 일, 오늘 할 일"

3. 개발(실행)

"코드 작성 → 테스트"

4. 스프린트 리뷰

"산출물 데모 & 피드백"

5. 회고

"뭐가 잘 됐고 뭘 바꿀까?"

AI 세션

1. 세션 시작: 목표 설정

"오늘 AI로 뭘 해볼까?"

2. 컨텍스트 공유

"지금까지 한 내용 알려주기"

3. 반복 작업

"프롬프트 → 확인 → 수정"

4. 결과물 검토

"AI 산출물 검토 · 수정"

5. 세션 리뷰

"어떤 프롬프트가 잘 됐나?"

완벽한 한 방 프롬프트는 없다

짧게 시도 → 확인 → 수정 = 가장 효과적인 AI 활용법

문지기에서 전략가로

AI와의 관계는 "매번 확인"에서 "전략만 세우기"로 성장한다

🚪

문지기

Human-in-the-Loop

"AI가 추천하면

내가 승인해야 실행"

예: 의료 진단, 중요 고객 응대

위임 Lv 1-3 / AI 자율 Lv 1-2

🖥️

감독관

Human-on-the-Loop

"AI가 자율 실행,

이상하면 내가 개입"

예: 콘텐츠 필터링, 일상 문의 응대

위임 Lv 4-5 / AI 자율 Lv 3

🗺️

전략가

Human-out-of-the-Loop

"AI가 완전 자율 실행,

나는 방향만 설정"

예: 일정 알림, 정기 리포트 자동 생성

위임 Lv 6-7 / AI 자율 Lv 4-5

경험과 신뢰가 쌓이면 → 오른쪽으로 이동

높은 자율성이 무조건 좋은 게 아닙니다.

상황에 따라 적절한 레벨을 선택하는 것이 핵심입니다.

TOPIC 4 · 워크플로우 패러다임

대화를 넘어 시스템으로

AI 활용의 4단계 진화

💬

대화

Chat

나 ↔ AI

매번 물어봄

일회성

내 역할: 질문자

↑ 여러분은 여기

⚙️

워크플로우

Workflow

나 → AI → AI → 결과

레시피대로

반복 가능

내 역할: 설계자

오늘의 목표

🤖

에이전트

Agent

AI → AI, 도구 ↔ 도구

알아서 판단

목표 지향

내 역할: 감독자

로드맵

🏇

하네스

Harness

시스템이 알아서

나는 승인만

먼저 다가옴

내 역할: 의사결정자

미래

워크플로우 5가지 패턴

Anthropic 공식 분류 — 대부분의 업무는 1~2번으로 충분합니다

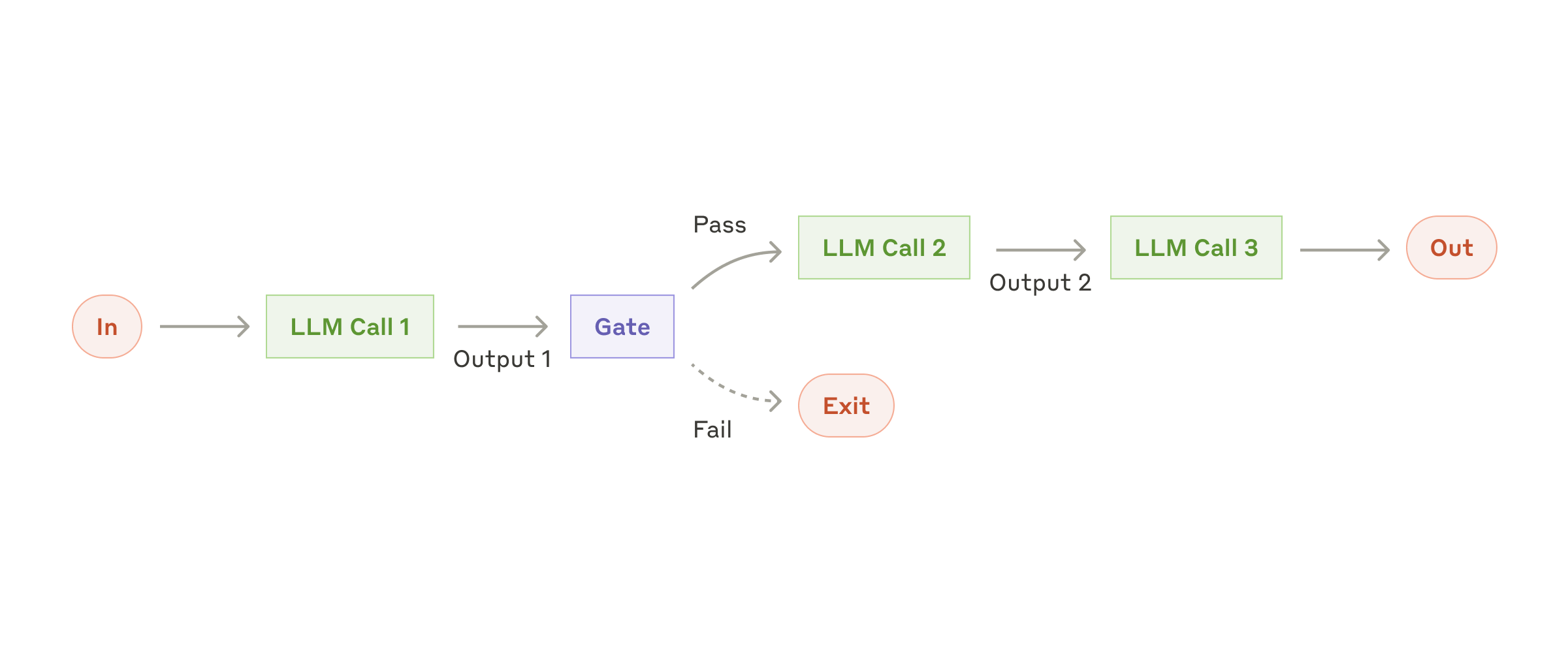

패턴 1

프롬프트 체이닝

(순차 처리)

입력 → [AI 1단계] → 검증 → [AI 2단계] → 결과

예: 문의 분류 → 초안 작성 → 검수

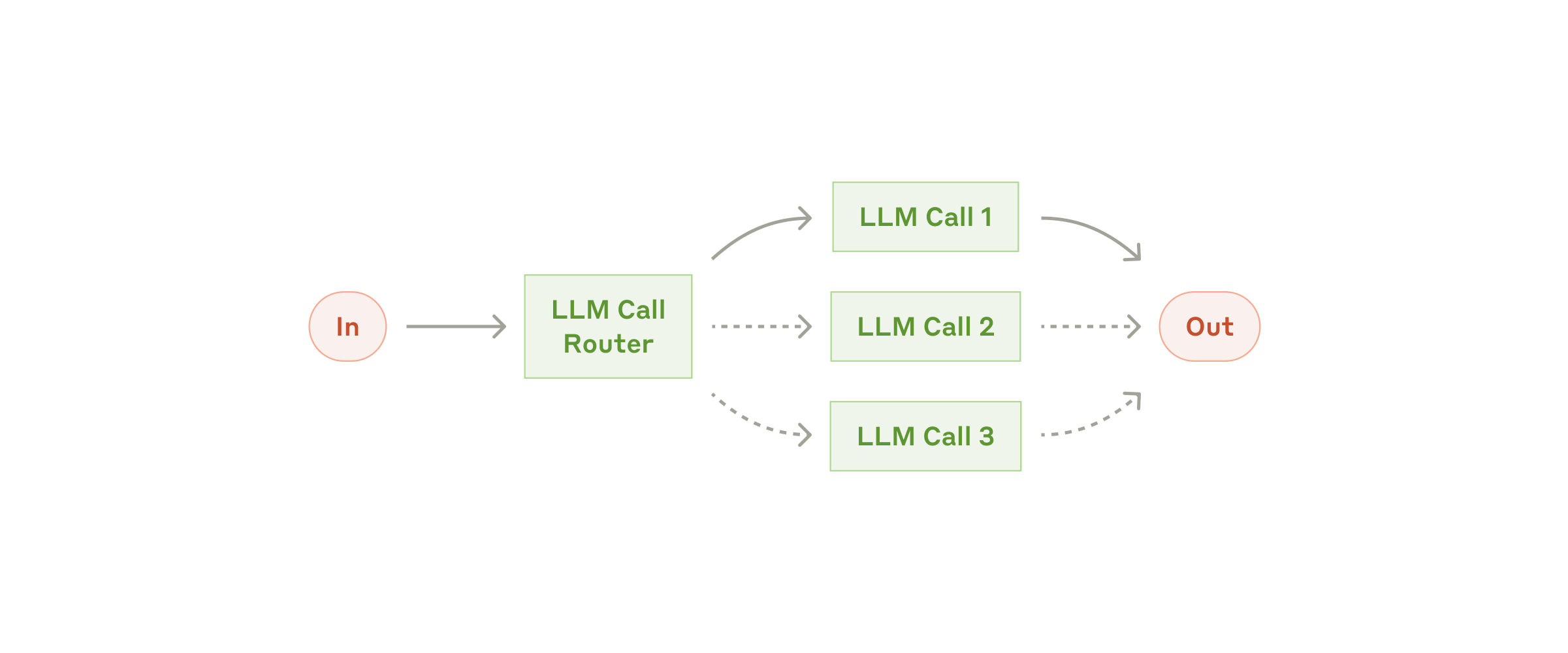

패턴 2

라우팅

(분기 처리)

입력 → [분류] → 유형A / 유형B → 각각 다른 처리

예: 가격 문의 / 예약 변경 / 불만 → 각각 다른 답변

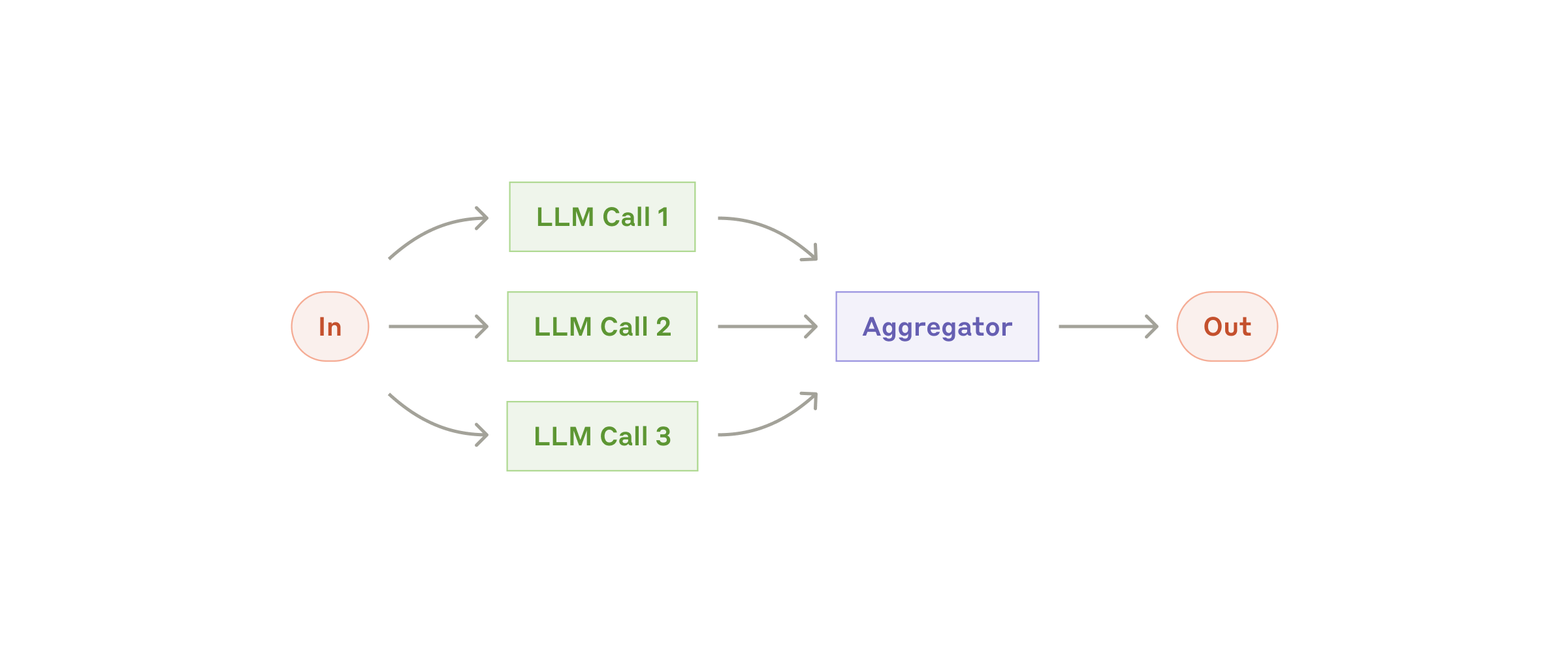

패턴 3

병렬화

(동시 처리)

입력 → [AI-1, AI-2, AI-3 동시] → 종합

예: 하나의 리뷰를 톤 / 정확성 / 정책 동시 검사

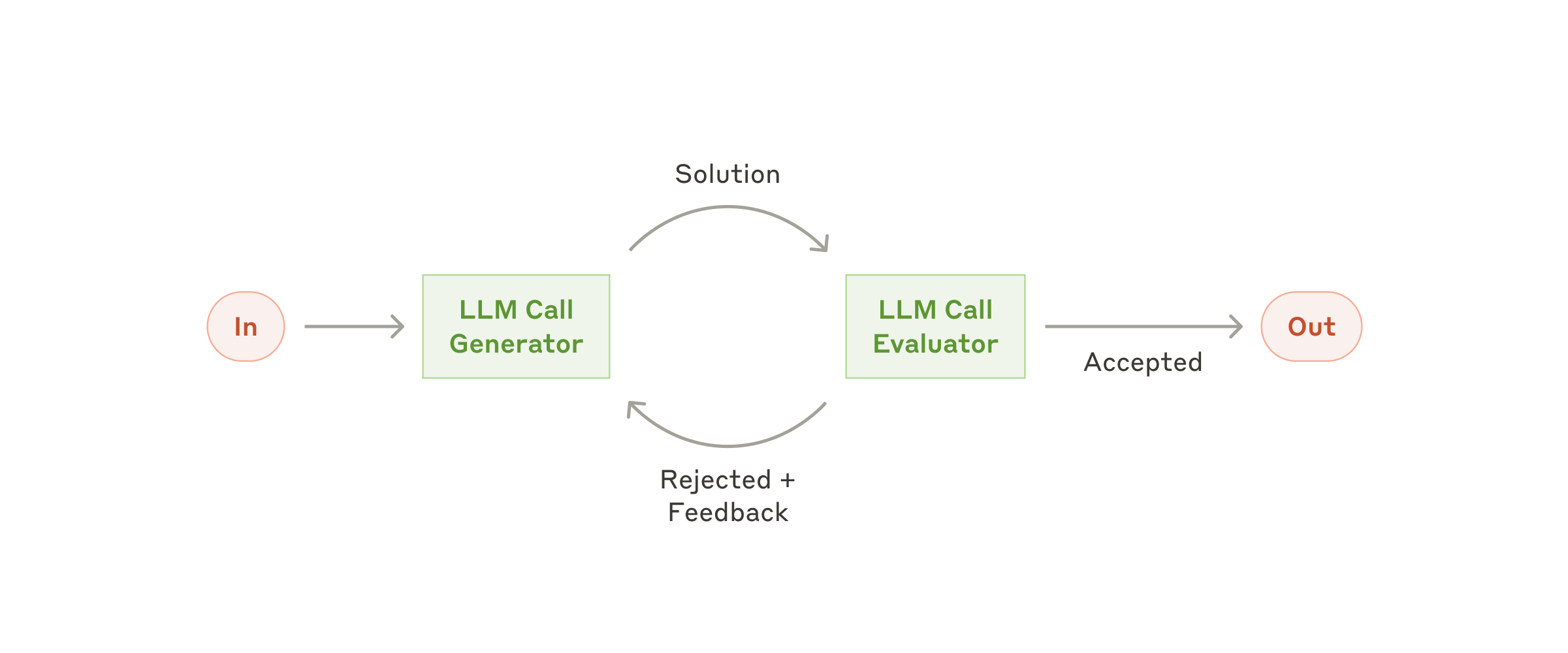

패턴 4

오케스트레이터-워커

(총괄 + 분업)

[총괄 AI] → [작업자A, 작업자B] → 결과 취합

예: SNS 콘텐츠 → 텍스트 / 이미지 / 일정 각각 처리

[생성 AI] ←→ [평가 AI] (반복) → 완성

예: 블로그 초안 ↔ 품질 평가 → 수정 → 재평가 → 완성

출처: Anthropic — Building Effective Agents (2024)

하네스 5대 요소

AI를 안전하게 모는 장비 — AI 자체가 아닌 주변 환경을 설계하는 것

🧰

도구 오케스트레이션

"이 비서에게

어떤 업무를 맡길지 정하기"

✋

인간 체크포인트

"중요한 건

나한테 물어보기"

새 직원 온보딩 패키지와 같다 — 매뉴얼 + 체크리스트 + 전문 역량 + 결재 권한

하네스 재설계만으로 모델 변경 없이 성능 52.8% → 66.5% 향상 (LangChain)

Before / After — 자율성 사다리

대화(Level 0)에서 에이전트(Level 3)까지, 개입이 줄어들수록 시간이 확보된다

Lv 0

대화

문의 → 나: 읽기 → 나: Claude에 물어보기 → 나: 복붙 → 답장

10-15분

Lv 1

보조

문의 → Claude Projects(저장된 지침으로 초안) → 나: 수정/전송

3-5분

Lv 2

자동화

문의 → 자동 분류 → AI 초안 자동 생성 → 나: 확인/승인

1-2분

Lv 3

에이전트

문의 → AI: 분류/초안/전송 자동 → 나: 일일 리포트만 확인

하루 5분

오늘의 목표 → Level 1 | 나머지는 로드맵으로 가져가세요

"나"의 역할 변화

직접 하는 사람에서 방향을 정하는 사람으로

현재

🏃

실행자

"직접 질문하고,

직접 복붙하고,

직접 전송"

"내가 다 해"

일하는 시간: 8시간/일

6개월 후

👀

감독자

"AI 결과를 확인/승인하고,

예외만 처리"

"AI가 하고 나는 검토"

일하는 시간: 5시간/일

1년 후

🏗️

설계자

"시스템을 설계하고,

가끔 방향만 조정"

"시스템이 돌고 나는 전략"

일하는 시간: 3시간/일 + 전략

"AI에게 뭘 물어볼까?"

→ "AI가 어떤 프로세스를 실행하게 할까?"

"내가 직접 해야 해"

→ "내가 설계하고 AI가 실행하게 하자"

에너지 재배분

"더 적게 일하자"가 아니라 — 같은 시간에 더 가치 있는 일을 하자

AI가 반복 업무를 맡으면 ↓

After

워크플로우

반복 20%

판단/의사결정 40%

전략/창의적 사고 40%

관계 · 판단

20% → 40%

회원과의 시간

"AI는 딸깍 한 번으로 끝나는 마법이 아닙니다.

함께 걸어나가며, 조금씩 더 잘하게 되는 여정입니다."

TOPIC 1

발전사

어떻게

여기까지 왔는가

"문제를 풀며

진화해왔다"

→

TOPIC 2

메타 프롬프팅

지금 AI와

어떻게 대화하나

"말이 새로운

코드다"

→

TOPIC 3

인간-AI 협업

구체적으로

어떻게 함께 일하나

"함께할 때

더 강하다"

→

TOPIC 4

워크플로우

한 걸음 더 나아가면

어떤 모습인가

"대화를 넘어

시스템으로"

이 4가지를 알면, AI를 도구가 아닌 파트너로 바라보게 됩니다.

내일, 딱 1가지만

작게 시작하세요. 그리고 다음 주에 하나 더.

A. 업무 정리

Claude에게 오늘의

업무 정리를 부탁하기

"오늘 할 일을 우선순위별로 정리해줘.

내 업무는 [ ]이야."

소요: 2분 | 위임 Lv.3 (자문)

B. 메시지 초안

반복하는 메시지 하나를

AI 초안으로 바꾸기

"이 문의에 대한 답변 초안을 만들어줘.

우리 센터의 특징은 [ ]이야."

소요: 5분 | 위임 Lv.3 (자문)

C. SNS 아이디어

이번 주 SNS 게시물을

AI와 함께 만들기

"필라테스/피트니스 관련 이번 주

인스타 게시물 아이디어 5개 제안해줘."

소요: 5분 | 위임 Lv.4 (합의)

실행 → 결과 확인 → 좋은 패턴 기록 → 지침에 추가 → 다음 실행에 반영

"가능한 가장 단순한 솔루션으로 시작하라."

— Anthropic, "Building Effective Agents"